ComfyUI 相关博客目录:

每一个使用 ComfyUI 或者其他 AI 绘图应用的人,尤其是初学者,大概率都有所体会:想要一张完全符合预期的图,总是耗费相当长的时间。你需要反复地换模型、调整参数、修改 prompt,几个小时过去,最终才能在上百张图中筛选出一张差强人意的图片。这和 “让 AI 解放你的生产力” 的口号实在是大相径庭。本篇博客,整理了作者本人在使用 ComfyUI 过程中踩过的一些坑,整理出来的一些实践小技巧,相信能够帮助你快速度过初学者的尴尬期,迅速提高出图效率和质量。

关于 Checkpoint 模型选取

SD 版本选取

从最早期的 Stable Diffusion v1.5 到 现如今的 Stable Diffusion XL,SD模型已经有多个应用中的版本。它们有着各自的特点和适用的场景,根据需要选择最适合的模型,能够帮助你提高出图的效率。话不多说,下面就是我整理的 SD 模型对比表格。

| 新度 | Lora / ControlNet 模型支持 | 支持的分辨率(像素) | 其他优势 | 硬件要求 | 出图速度 | |

|---|---|---|---|---|---|---|

| SD 1.5 | 最早 | 目前市场上很多 Lora 模型以及 ControlNet 模型都是基于v1.5来构建的,可用的模型比较多。 | 最优的生成图像大小是 512x512,部分基于 SD v1.5 微调的版本也支持 768x768 | / | 模型小,硬件要求低 | 快 |

| SD 2.0 | 中间版本 | 有不少 Lora 模型以及 ControlNet 模型,但不如 v1.5 多 | 512x512 768x768 |

采用了新的文本编码器 OpenCLIP,可以更好地理解文本提示 | 中 | 快 |

| SD XL | 最新 | 可用的Lora 模型等是最少的,很多作者还没有提供 SD XL 版本的支持。 | 最优的大小是 1024x1024 | 生成图像质量更高,引入了新的功能,如更有艺术感的图像,更真实的图像,以及更清晰可读的字体等 | 模型大,硬件要求高 | 慢 |

当然,以上表格中提到的出图速度并不绝对,只是在相同的条件下,用更小的模型可以更快地产出图片。但如果你的硬件足以支持你忽视那些模型影响,在算力溢出的情况下,使用 SD XL 则能够产出更精细的图片。不过,如果你的工作流中要用到一些小模型,那么 v1.5版本能够让你有更大的选择空间,毕竟 SD XL 出来也不算久,在插件以及 Lora 模型等的支持上要落后许多。

Checkpoint 模型风格选取

确定了我们要选择的版本以后,我们可以选择更贴近我们预期的图片风格的模型。更合适、贴切的 Checkpoint 模型,能够更好地帮助我们获得想要的图片。

比如 DreamShaper,这是一个 3d真实画风模型,它提供了多种 SD 版本的支持。

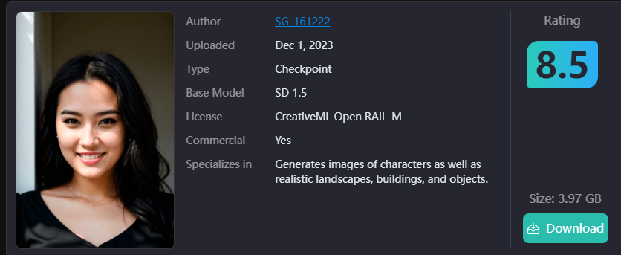

又比如 Realistic Vision,它是一个现实画风的模型。

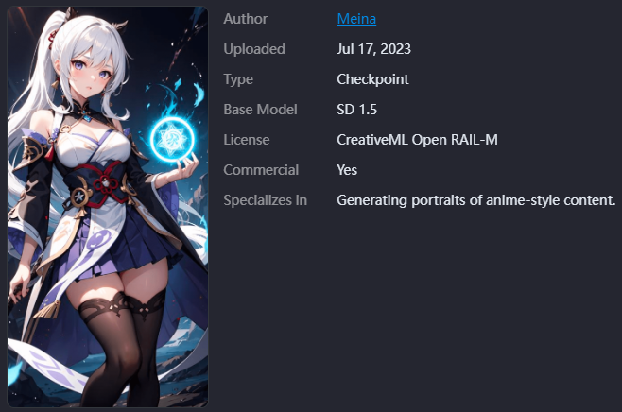

上面两个的模型对比可能还不够明显,那么请看 Meina Mix,它是一个二次元画风的模型。当你想要生成漫画风格图片的时候,用上面两种肯定行不通。同样,当你要生成一张电商模特图的时候,也不可能让使用 Meina Mix。

在C站,有很多可以免费下载的模型。不过要注意,正如我们前文所说,SD的版本很重要。你还需要确认模型右侧的 Base Model 是否符合你的预期。比如你想要用一个 Lora 来强调某种赛博朋克的风格,但是它只支持 SD v1.5,那么一个只有 SD v2.0 的 Checkpoint 模型就无法适配。如果你非要将它们放在一个工作流里运行,会收到抛错,中断你的工作流。因为我本人已经如此尝试过数次了,请相信我。

调参技巧

在 AI出图的过程中,不可避免地,我们会花费大量的时间用来“炼丹”,即不断地调整参数,启动工作流,然后查看是否获得了满意的结果。如果你能够掌握一些基础的调整参数的技巧,那么效率就可以得到很大地提升。

Latent Image

无论是空的潜空间 Empty Latent Image,还是由其他的图像提取得到的潜空间,都遵循以下的规律:

- 输入的图像参数,长、宽都必须能被8整除。

- 不同的 SD 模型有不同的最优出图尺寸,如果你想要一张更大的图片,更好的方法是在生成以后,再使用放大插件或是算法,总之是一个将图片放大的工作流,将图片放大到你满意的大小。

- batch size:这个数不要设置得太大。通常你都是调整 KSampler 采样器的参数,前期将每批生成的图片张数设置成一个合理的值,比如 4 会更好,这样你可以更快地迭代。等到你认为采样器的参数不必再调整了,再将这个值调整到 16 或是其他更大的值,供你在较多的图片中进行遴选。

KSampler

除了换模型外,我们最常调整的就是 KSampler 的参数。我们在调参时,应当尽量控制变量,以明确某个参数是否调整到位了。当然,有些调度算法和采样器需要结合起来,这就另说。这里给出以下几个小技巧

- 前期调参时,我们可以将随机种子 seed 设置为fix,这样更方便控制变量,对比不同参数下的出图效果。

- 注意调参顺序。我们可以先在 step 相对低的情况下,调整 cfg。cfg 通常为6-8,部分为1-2或者3-4,因为改动 cfg 产生的影响会很明显,所以很好调。之后,我们再调整 KSampler 的采样器和调度算法。最后再调整 step,到一个适中的值即可,step 太大效率也会很低,而且效果不一定更好。

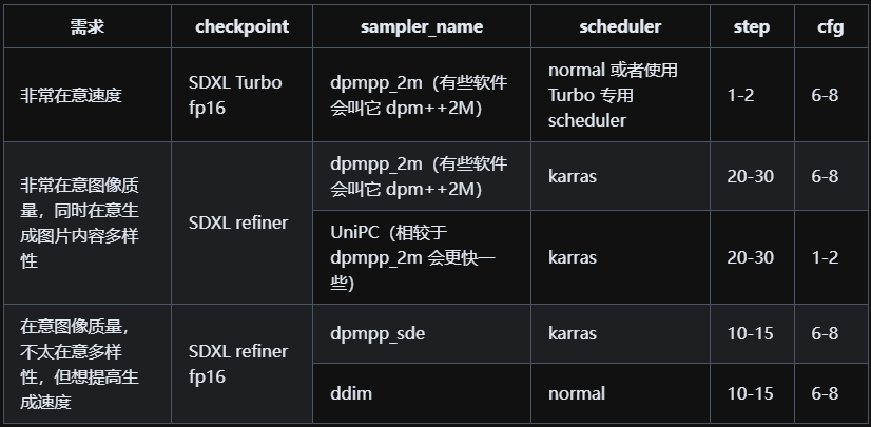

- KSampler 的配置跟模型(checkpoint)强相关,比如 SDXL-Turbo 因为对图片生成过程进行了压缩,其最佳 cfg 反而不能太大,实验下来,1 或 4 最好。也可以参考下载模型时,模型页面上作者提供的参数,这些参数通常都是该模型的最佳实践。

下图是 Comflowy 上提供的 KSampler 的一些最佳实践,虽然仍旧有些笼统,但是作为参考,还是能帮你少走很多弯路、少做很多无用功。

Prompt

关于如何写提示词 prompt ,我在 《AI绘图神器:ComfyUI零基础入门指南(一)》中已经提过。如果你没有读过,我在这里也重新放上来了。通常写 prompt 要注意长度、排序和符号。

- 长度:不是越长越好,最好保持在75个 token(或约 60 字)以内,以精准描述为主。

- 排序:越重要的词越靠前。比如主体的描述要放在背景前。

- 符号

- 逗号:使用逗号分割token e.g. beautiful scenery, nature glass bottle landscape, purple galaxy bottle

- 括号:使用括号调整权重,大于 1 表示权重变高,小于 1 表示权重降低。 e.g. (high building:1.2)

- 模板

- 主体(首位)

- 环境:主体所处的环境,环境的氛围、光线/灯光,天气等。

- 媒介:相机/油画/相片等

- 风格:什么年代的风格/哪位艺术家或者哪种艺术风格/什么国家或者文明的风格

要点其实很简单,你或许会觉得轻而易举,但是尝试以后又发现不尽人意。没关系,要将 prompt 写好是一门学问,你可以一边参考 openart 上优秀作者提供的 prompt ,一边对比修改自己的。很快你就会有所进步。例如下面这个小王子的示意图,它的 prompt 是 ‘the little prince standing on small planet in starry sky, by saint exupery, crocheted style’。

风格化技巧

AI绘图中还有一些常用的提升出图质量的小模型,比如 Embedding, LoRA。它们的作用都相当神奇,在这里我会简单介绍它们的功能和使用方法。至于更详细的内容,受限于篇幅,我会在其他的博客中更详细地展开介绍。

LoRA

LORA,一个非常神奇且强大的东西。它是一种小模型,能够在不破坏任何一层函数的情况下,将参数注入到原有的每一层中。实际效果就是,它能够像加滤镜一样实现出图风格的控制。使用 LoRA 能让我们轻松地控制出图的风格,就好像我们拍了一张不怎么样的照片,但加上了富士滤镜,就能够发朋友圈了一样。

LoRA 的使用也非常简单,下载 LoRA 模型,在 prompt 中加入,例如 <lora:ipadapter/color background.safetensors:1.2> ,或者使用 LoRA 节点。

Embedding

CLIP 模型(就是我们在《入门篇》提到的翻译官),它建立了图和文的映射。而实际使用过程中,我们可以修改某部分指定的图文映射,来实现更加针对性的效果提升,比如我们将“小狗狗”特别映射到“斑点小狗狗的图片”。但是,我们无法在 ComfyUI 中直接训练模型,只能使用已经训练好的模型。而 Embedding 就是那个已经训练好的模型。比如原来不加 Embedding,如果要画一只猫,那么大概率会画出橘猫,而现在通过针对性的训练,我们可以让它画出一只加菲猫。

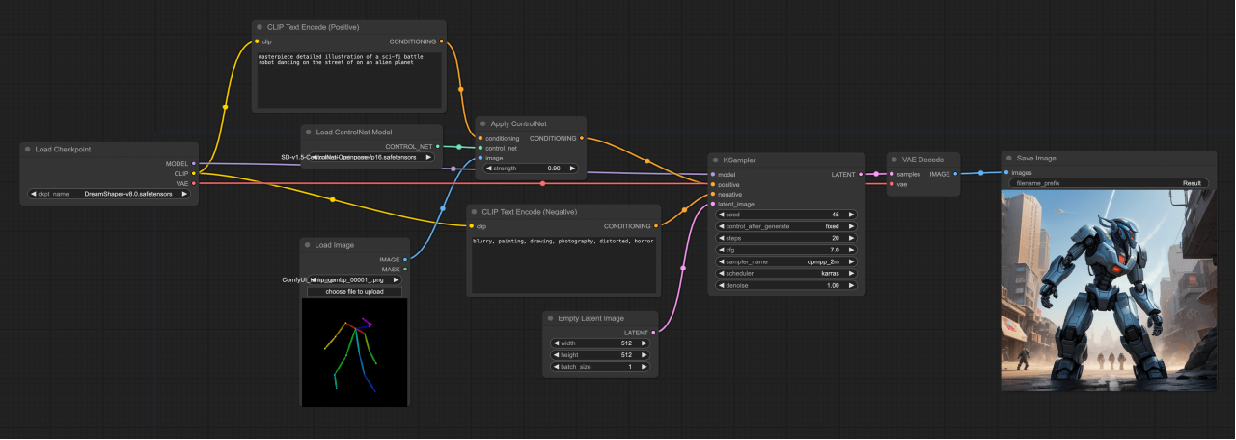

ControlNet

ControlNet 支持我们通过输入姿势图的方式,来控制生成的人物的姿势。这些姿势图,可以是骨架图或者深度图、边缘草绘图,你只需要根据输入选择对应的ControlNet 模型(pose/canny)即可。

IP-Adapter

IP-Adapter,可以说是一图 LoRA 神器,一张图就能够实现接近一个 LoRA 模型的效果。它的功能非常强大,只要输入一张或几张参考图,就能够提取参考图的风格特征,并注入到我们的迭代过程中,控制生成图片的风格。当然,不同的 IP-Adapter 模型,比如 plus 版本 或者 face 版本,它们都有各自的优势。

希望以上的一些 ComfyUI 使用小技巧,能够帮助你更高效地使用它,真正实现 “让 AI 解放我们的生产力”。如果你有什么独门妙招,或者是经验之谈,非常欢迎一起交流进步~

- 本文作者: Berry

- 本文链接: https://wuxinberry.github.io/2024/12/25/ComfyUI-tips/

- 版权声明: 本博客所有文章除特别声明外,均采用 MIT 许可协议。转载请注明出处!